EthoClaw 是什么?

EthoClaw 是广东一湾生命科技有限公司 面向神经行为学、药效评价和动物行为研究领域研发的 开源智能体项目。

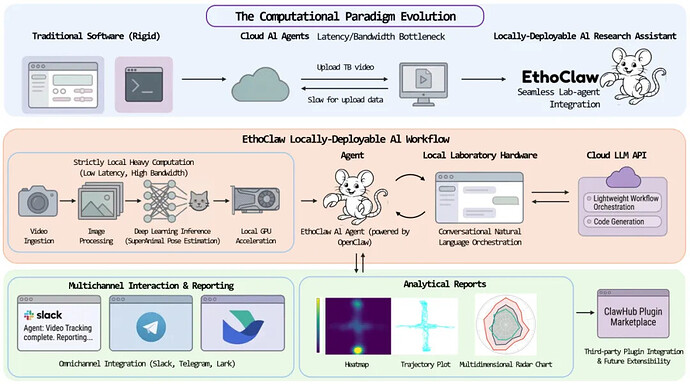

它基于 OpenClaw 项目构建,以自然语言驱动,覆盖从原始视频输入到论文可发表结果的全流程,能够充分利用本地计算资源,规避海量数据上传云端的带宽瓶颈。

EthoClaw 的预印版论文已经在 bioRxiv 上线,GitHub 上已有完整代码和文档,欢迎下载使用,有问题可以在 GitHub 上提 Issue。

bioRxiv 链接:

https://doi.org/10.64898/2026.03.25.714141

GitHub 链接:

01 解决痛点

做动物行为分析,绕不开这些环节:

-

视频标注需要人工逐帧完成,DeepLabCut 虽好,但每换一台电脑就要重装一遍环境

-

Python、MATLAB 画图功能强大,但调样式、配色的时间往往比数据分析本身还长

-

GraphPad Prism 是标配,但导数据、选统计方法、写方法部分,全靠手动

EthoClaw 想做的事很简单:把这些碎片化的工具,用 AI 串联成一个完整的工作流,让研究者只需说一句要什么,就能拿到可以直接用的结果。

02 核心功能介绍

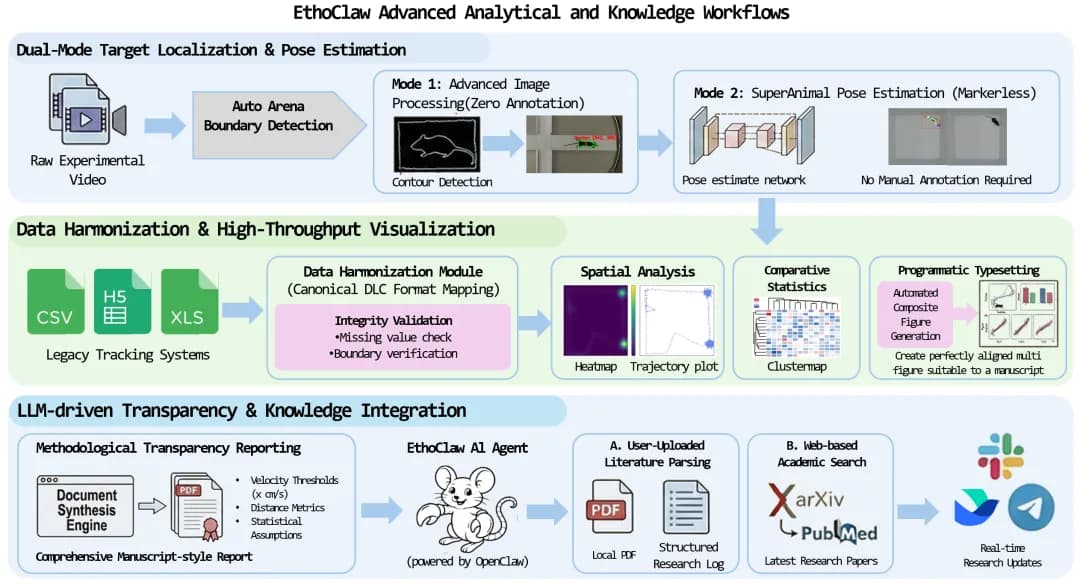

| 零样本姿态估计 |

EthoClaw 提供双模态追踪架构,可直接传入原始实验视频。

第一种模式基于图像处理的快速目标检测,适用于高对比度场景(如白底上的黑色小鼠),无需任何标注,CPU 即可快速运行。

对于更高精度的姿态分析,EthoClaw 直接集成 DeepLabCut SuperAnimal 预训练模型,调用 superanimal_topviewmouse,可输出 27 个解剖关键点(头部 8 点、躯干 8 点、四肢 6 点、尾部 5 点),直接对俯视小鼠视频进行无标注的姿态估计。在标准开放场测试中,单个视频(640×360 分辨率,30Hz,5 分钟,共 9,000 帧)从输入到输出全程自动完成,无需人工干预。

告别逐帧标注,拥抱即拍即分析。

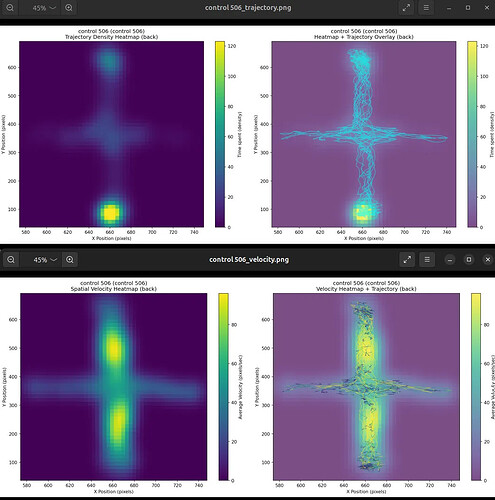

| 轨迹热图 & 速度热图 |

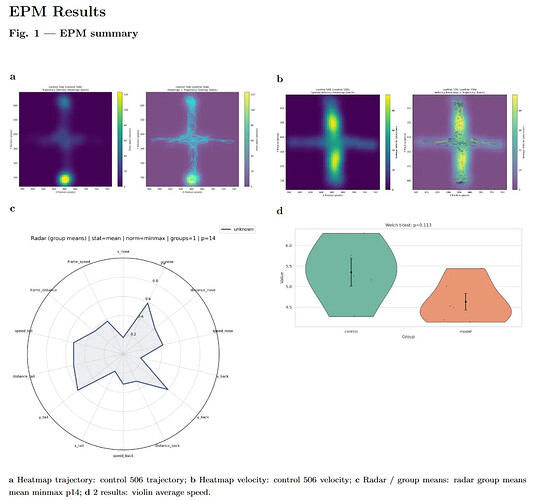

提供追踪数据后,一键生成 publication 级可视化图表。系统可自动生成轨迹热图和速度热图。

不用写代码,对话形式生成热图

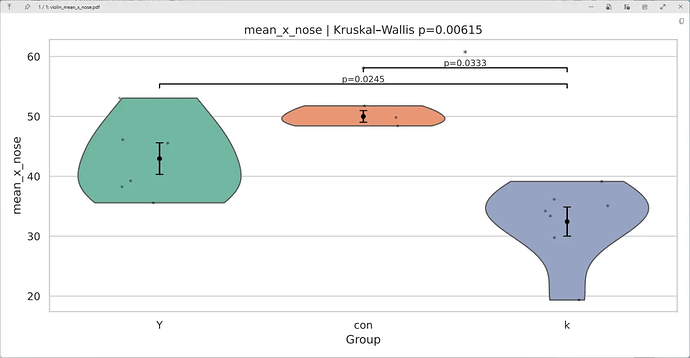

| 多组统计分析与小提琴图 |

基于标准化 HDF5 数据,EthoClaw 自动计算运动学参数(速度、加速度、停留时间等),并执行组间统计检验。两组数据默认 Welch’s t 检验,三组及以上使用 Kruskal-Wallis 检验,组间差异显著时自动执行两两比较并用 Holm-Bonferroni 方法校正 p 值。结果以小提琴图呈现,叠加原始数据点、均值±SEM 误差棒,并直接在图上标注显著性。

还在手动粘贴数据到 GraphPad 进行统计吗?

这些和 EthoClaw 对话就行。

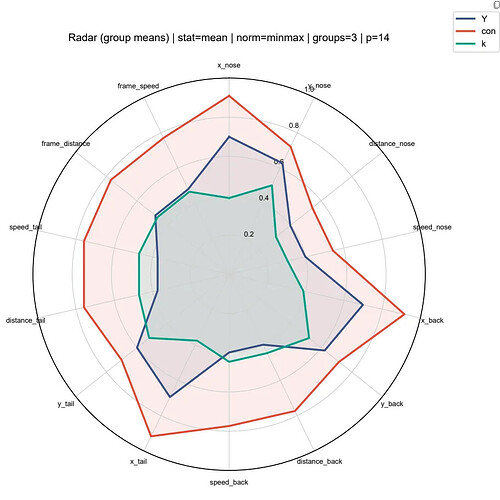

| 多维雷达图与聚类分析 |

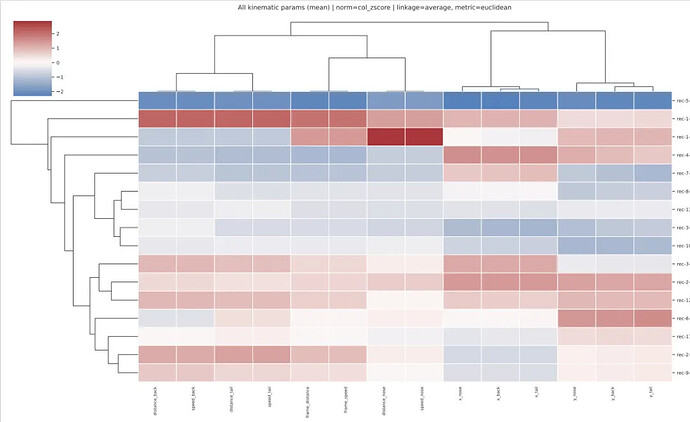

支持多维参数雷达图,可视化各实验组在所有运动学维度上的整体表型差异。同时提供层次聚类热图,参数差异一目了然。

多组参数可视化对比

| 论文自动排版 |

结果图自动排版为 Figure,配有 a/b/c/d 子图编号、标题和图注,支持导出 LaTeX 或 PDF。

Adobe Illustrator 能做的排版活,

现在可以交给 EthoClaw。

| 分析报告自动生成 |

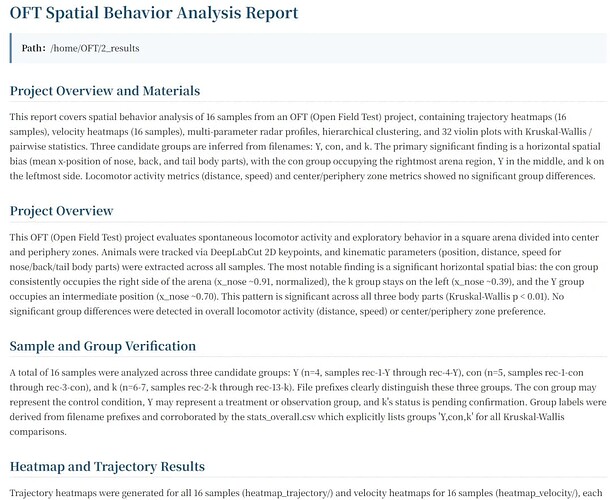

完成分析流程后,系统自动生成包含实验背景、样本信息、统计结果和结论的结构化报告。如有疑问还可继续和 EthoClaw 对话,获取各步骤的计算细节。

审稿人质疑方法部分不清晰?

直接和 EthoClaw 对话获取细节。

| 文献追踪与知识库 |

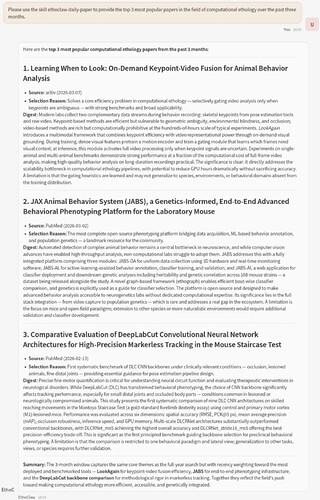

支持从 arXiv / PubMed 获取每日最新的相关领域论文,自动排序并生成摘要简报。同时支持解读本地 PDF 文献,自动解析并生成结构化输出。最终形成本地前沿论文库或研究日志。

追踪前沿文献这件事,以后不用每天手动刷了。

03 技术架构

EthoClaw 基于 OpenClaw 项目构建,以对话形式驱动,利用本地计算资源分析,规避海量数据上传云端的带宽瓶颈。

-

多 Skills 驱动的行为学分析: OpenCV 图像处理(快速模式,中心点追踪)+ DeepLabCut SuperAnimal(高精度模式,多点追踪)无标记动物自动追踪模块;数据标准化模块,自动转为DeepLabCut 的兼容格式;基于Python 的scipy/statsmodels/scikit-learn 等统计可视化模块;以及报告生成、Figure 自动排版、文档总结、论文联网搜索模块等。

-

性能优化: 优化 OpenClaw 源码,提升了高频工具调用场景下的响应速度,优化了体验。

-

数据标准化: 统一转换为 DeepLabCut 兼容格式(HDF5/CSV),支持 CSV、Excel、HDF5 混合来源

-

兼容 OpenClaw 生态: 能够接入 ClawHub 等社区的海量插件,能够接入飞书、Telegram 等平台,实现远程分析。

推荐配备 NVIDIA GPU;无 GPU 亦可运行,但可能无法使用基于 SuperAnimal 的动物姿态估计。

04 开源说明

首个版本(v1.0.0)已发布在 GitHub,MIT 许可证,完全免费。

当前版本的已知限制:

-

目前聚焦于单动物俯视范式,尚未支持 3D 追踪和多动物身份追踪

-

目前追踪和姿态估计模块仅支持白色背景下的黑色小鼠

-

暂时无法使用交互式操作来划定特定区域,如高架十字实验开放臂等,但可以通过对话形式告诉 EthoClaw 坐标来进行分析

-

分析全过程由 AI 运行,可能有误,强烈建议人工复核各环节结果

欢迎提交 Issue 反馈问题。我们希望通过开源,有更多人参与进来,才能让这个工具更快变得完善。

云端体验版正在部署,上线后将同步公告。

EthoClaw 预印版论文现已发布在 bioRxiv,可通过下方链接查看技术细节。

相关链接

GitHub:

bioRxiv 论文:

https://doi.org/10.64898/2026.03.25.714141

体验版: (即将上线)

| 开发团队 |

黄 康,陈 可,陈梓明,郑大港,方 翔,梁境鸿,

李振勇,陈雨锋,邹洁蒙,蔡炳东,陈善达